Входной трансформатор — усилитель — Большая Энциклопедия Нефти и Газа, статья, страница 1

Входной трансформатор — усилитель

Cтраница 1

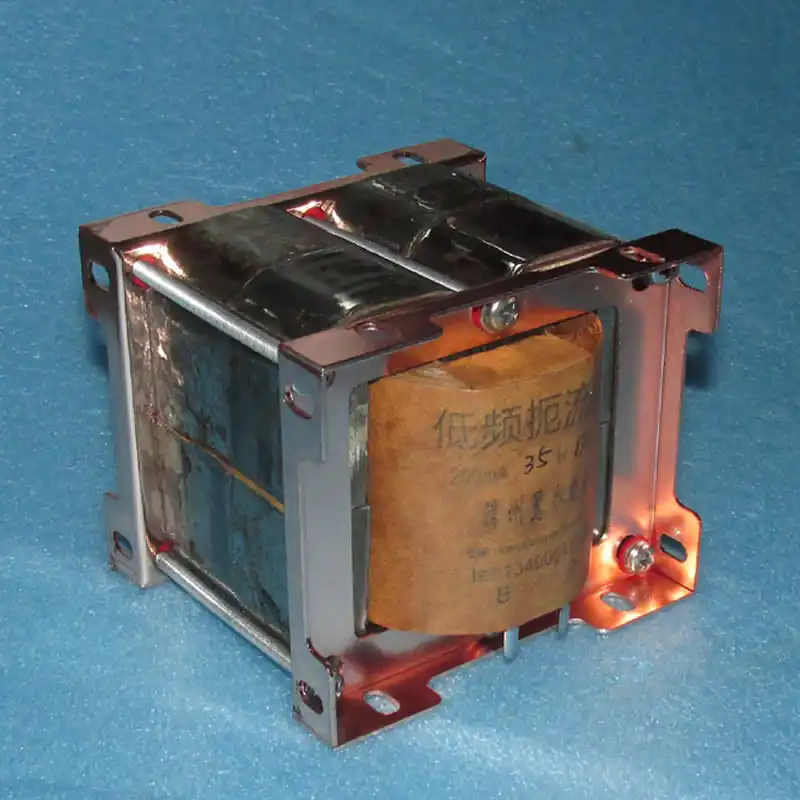

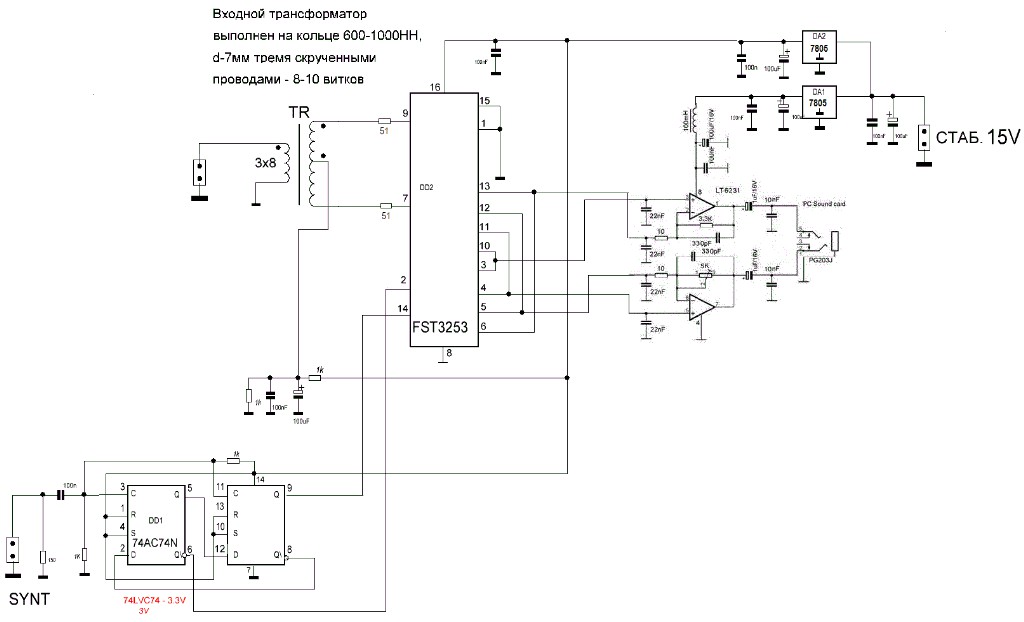

Входные трансформаторы усилителей имеют большое количество витков и поэтому являются основными приемниками магнитной наводки. Как показала практика, обмотки входных трансформаторов необходимо наматывать на П — образное железо. [1]

Входной трансформатор усилителя ( см. табл. 8 — 1) обеспечивает величину входного сопротивления измерительного прибора около 200 ком. В схеме усилителя с высокоомным входом в отличие от схемы рис. 8 — 5 исключается цепь параллельной обратной связи по постоянному току. Это необходимо для увеличения входного сопротивления. [2]

Входной трансформатор усилителя Tpi повышает напряжение сигнала, благодаря чему значительно уменьшается доля флуктуаци-онных шумов, вносимых входной лампой JIi.

Стержневую конструкцию с двумя катушками иногда используют для входных трансформаторов усилителей с очень малым входным уровнем вследствие малой чувствительности к внешним магнитным полям. [5]

В автокомпенсаторе постоянного тока для дистанционного измерения сопротивлений дифференцирующая цепь образована первичной обмоткой входного трансформатора усилителя и сравнивающим конденсатором, подключаемых с помощью позиционного вибропреобразователя к калиброванным сопротивлениям измерительной схемы. [6]

На входе усилителя находятся так называемый компенсационный контур, в котором складываются или вычитаются отдельные сигналы и подаются на входной трансформатор усилителя. [7]

К числу основных источников внутренних наводок в регистрирующих приборах относятся силовые трансформаторы и модуляторы, а к числу основных приемников — входные трансформаторы усилителей, что обусловило особую тщательность в разработке конструкций этих элементов. Сдвиг нулевого уровня прибора, вызываемый постоянными по действию наводками, может быть скомпенсирован, и тогда он не вносит погрешности в измерения. Дрейф нуля принято характеризовать максимальным отклонением ложного выходного сигнала от среднего значения за определенное время наблюдения.

[8]

Сдвиг нулевого уровня прибора, вызываемый постоянными по действию наводками, может быть скомпенсирован, и тогда он не вносит погрешности в измерения. Дрейф нуля принято характеризовать максимальным отклонением ложного выходного сигнала от среднего значения за определенное время наблюдения.

[8]

Воздействие нагрузки на первичный прибор вызывает — изменение сопротивлений плеч моста проволочных датчиков, баланс моста нарушается и по первичной обмотке [9]

[9]

Электронно-контактный регулятор типа IIP-130: а — схема; б — характеристики; / — входной потециометр; 2 — потенциометр обратной связи; 3 — входной трансформатор усилителя интегрирующего устройства; 4 — трехпозиционнос реле; 5 — интегрирующий электродвигатель; 6 — сопротивления электронагревателя; 7 — интегрирующие реостаты; 8 — концевые выключатели; 9 — термометры сопротивления; 10-выходной трансформатор усилителя исполнительного устройства. [10]

Стержневые трансформаторы менее чувствительны к наводкам от посторонних магнитных полей вследствие компенсации наводимой в одной катушке эдс другой катушкой; поэтому иногда стержневую конструкцию применяют для входных трансформаторов усилителей с очень низким уровнем входного сигнала. [12]

Стержневые трансформаторы менее чувствительны к наводкам от посторонних магнитных полей вследствие компенсации наводимой в одной катушке эдс другой катушкой; поэтому иногда стержневую конструкцию применяют для [14]

[14]

Страницы: 1 2

входной трансформатор — это… Что такое входной трансформатор?

- входной трансформатор

- input transformer

Большой англо-русский и русско-английский словарь. 2001.

- входной транспортер

- входной трап

Смотреть что такое «входной трансформатор» в других словарях:

входной трансформатор — — [Я.Н.Лугинский, М.С.Фези Жилинская, Ю.С.Кабиров. Англо русский словарь по электротехнике и электроэнергетике, Москва, 1999 г.] Тематики электротехника, основные понятия EN input transformer … Справочник технического переводчика

входной трансформатор — įėjimo transformatorius statusas T sritis fizika atitikmenys: angl.

input transformer vok. Eingangsübertrager, m; Eingangstransformator, m; Vorübertrager, m rus. входной трансформатор, m pranc. transformateur d’entrée, m … Fizikos terminų žodynas

input transformer vok. Eingangsübertrager, m; Eingangstransformator, m; Vorübertrager, m rus. входной трансформатор, m pranc. transformateur d’entrée, m … Fizikos terminų žodynasвходной согласующий сигнальный трансформатор — Согласующий сигнальный трансформатор для согласования внутреннего полного электрического сопротивления источника сигнала с полным входным сопротивлением функционального узла электронной аппаратуры [ГОСТ 20938 75] Тематики трансформатор… … Справочник технического переводчика

входной — 7.2.4 входной (прилагательное): Относящийся к устройству, процессу или каналу ввода вывода участвующему в процессе ввода, или к соответствующим данным или состояниям. Примечание Слово «вход» может использоваться вместо слов «входные данные»,… … Словарь-справочник терминов нормативно-технической документации

Входной согласующий сигнальный трансформатор — 26. Входной согласующий сигнальный трансформатор Входной трансформатор D.

Anpassender Eingangssignalübertrager E. Matching input transformer F. Transformateur d’adaptation d’éntrée Согласующий сигнальный трансформатор для согласования внутреннего … Словарь-справочник терминов нормативно-технической документации

Anpassender Eingangssignalübertrager E. Matching input transformer F. Transformateur d’adaptation d’éntrée Согласующий сигнальный трансформатор для согласования внутреннего … Словарь-справочник терминов нормативно-технической документациивходной изолирующий трансформатор источника бесперебойного питания — Трансформатор, включаемый во входную цепь ИБП для обеспечения гальванической развязки его внутренних узлов и входной электросети. Применяется во избежание короткого замыкания цепей ИБП, комплектуемого негерметичной аккумуляторной батареей с… … Справочник технического переводчика

ТРАНСФОРМАТОР — ТРАНСФОРМАТОР, устройство для преобразования переменного тока и НАПРЯЖЕНИЯ с сохранением частоты. Состоит из двух или более проволочных обмоток, намотанных на сердечник и индуктивно связанных. Входной ток подается на одну из обмоток (первичную),… … Научно-технический энциклопедический словарь

выходной изолирующий трансформатор источника бесперебойного питания — Трансформатор, включаемый в выходную цепь ИБП для обеспечения гальванической развязки между ИБП и его нагрузкой.

В трехфазных системах применяется трансформатор «треугольник звезда». Он образует выходную нейтраль нагрузки, полностью… … Справочник технического переводчика

В трехфазных системах применяется трансформатор «треугольник звезда». Он образует выходную нейтраль нагрузки, полностью… … Справочник технического переводчикаГОСТ 20938-75: Трансформаторы малой мощности. Термины и определения — Терминология ГОСТ 20938 75: Трансформаторы малой мощности. Термины и определения оригинал документа: 73. Асимметрия обмоток трансформатора малой мощности Асимметрия обмоток D. Wicklungsunsymmetrie des Kleintransformators E. Winding asymmetry F.… … Словарь-справочник терминов нормативно-технической документации

Эхо (реверберационная приставка) — Реверберационная приставка «Эхо» предназначена для получения эффекта реверберации при подключении к любому источнику сигнала. В анонсе, опубликованном перед выпуском приставки [1], ей уделён всего один абзац: «Для монофонических приёмников… … Википедия

Параметрический усилитель — радиоэлектронное устройство, в котором усиление сигнала по мощности осуществляется за счёт энергии внешнего источника (так называемого генератора накачки), периодически изменяющего ёмкость или индуктивность нелинейного реактивного… … Большая советская энциклопедия

Трансформация для организации

Алексей Телегин, ведущий блога по источникам питания Keysight Technologies

Мы продолжаем знакомить читателей с материалами, посвященными базовым понятиям и подходам в использовании источников питания (ИП), современным решениям в данной области и уникальным функциям, помогающим выполнить самые сложные задачи, возникающие при тестировании. В этом номере ведущий раздела по системам электропитания объединенного блога Keysight Technologies в России Алексей Телегин обсуждает решение вопросов КПД источников питания.

В этом номере ведущий раздела по системам электропитания объединенного блога Keysight Technologies в России Алексей Телегин обсуждает решение вопросов КПД источников питания.

В большинстве применений существенным недостатком линейного источника питания постоянного тока является его невысокий (неоптимальный) КПД. Обычно можно спроектировать линейный ИП постоянного тока с надлежащим КПД, когда значения входного и выходного напряжения фиксированы. Тем не менее, если одно или оба напряжения различаются в широком диапазоне, после того как ИП постоянного тока будет соответствующим образом обеспечивать регулирование при низком входном напряжении и/или высоком выходном напряжении, он должен затем рассеять значительную мощность.

Для того чтобы использовать ИП постоянного тока, отсекающие линию переменного тока, задается достаточно широкий диапазон входного напряжения переменного тока. Повышение линейного напряжения на 35% с минимального до максимального значения считается обычной практикой. В современных ИП, основанных на коммутации по высокой частоте (импульсные ИП), решена проблема КПД как функции изменения входного напряжения линии. Однако прежде чем импульсные ИП для источников питания постоянного тока получили широкое распространение, были разработаны различные типы низкочастотных предварительных регуляторов.

В современных ИП, основанных на коммутации по высокой частоте (импульсные ИП), решена проблема КПД как функции изменения входного напряжения линии. Однако прежде чем импульсные ИП для источников питания постоянного тока получили широкое распространение, были разработаны различные типы низкочастотных предварительных регуляторов.

Предварительный регулятор — это контур, который подает регулируемое напряжение на линейный выходной каскад из нерегулируемого напряжения, выведенного из напряжения линии переменного тока с небольшой потерей мощности. Хотя данные схемы используются не так широко, как другие схемы предварительных регуляторов, в редких случаях феррорезонансные трансформаторы находили применение в качестве эффективного предварительного регулятора в источниках питания постоянного тока.

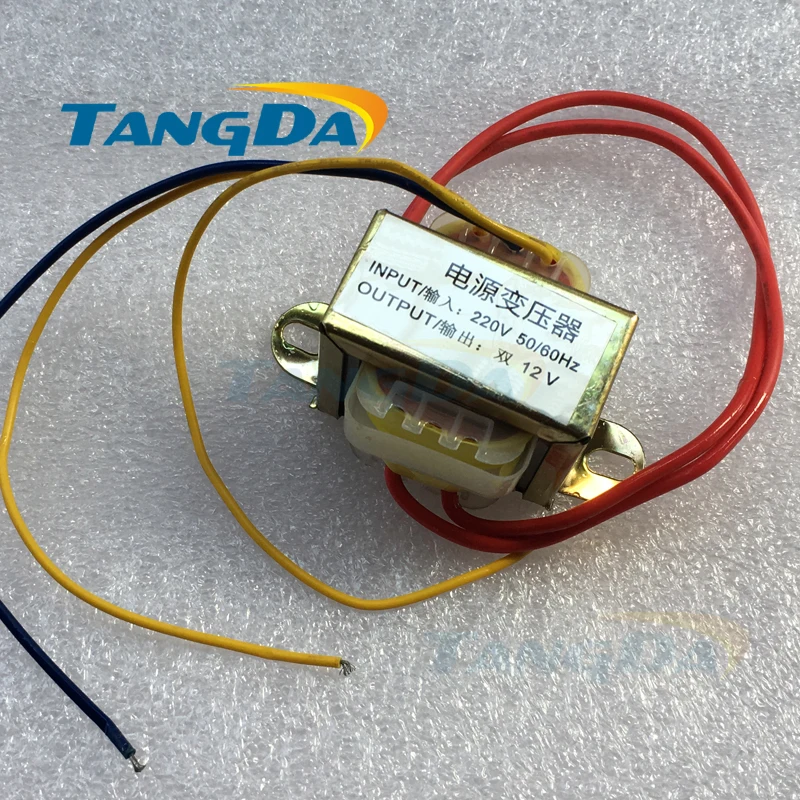

Что такое феррорезонансный трансформатор? Он напоминает обычный трансформатор тем, что преобразует напряжение переменного тока через первичную и вторичную обмотки. Но в отличие от обычного трансформатора, после достижения определенного уровня входного напряжения переменного тока, начинает регулировать свое выходное напряжение переменного тока на фиксированном уровне, даже если входное напряжение переменного тока продолжает расти, как показано на рис. 1. Феррорезонансные трансформаторы также часто называют трансформаторами-стабилизаторами напряжения, или CVT.

Но в отличие от обычного трансформатора, после достижения определенного уровня входного напряжения переменного тока, начинает регулировать свое выходное напряжение переменного тока на фиксированном уровне, даже если входное напряжение переменного тока продолжает расти, как показано на рис. 1. Феррорезонансные трансформаторы также часто называют трансформаторами-стабилизаторами напряжения, или CVT.

Рис. 1. Передаточная характеристика входа-выхода феррорезонансного трансформатора

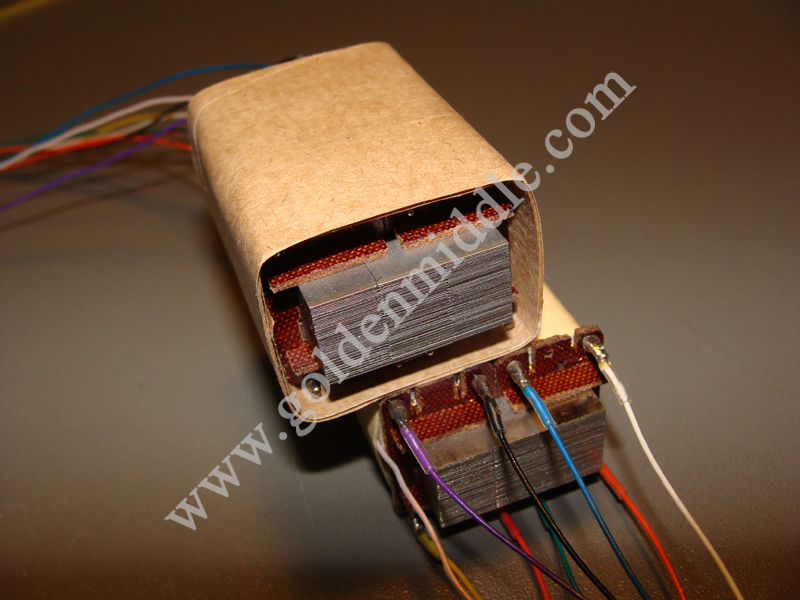

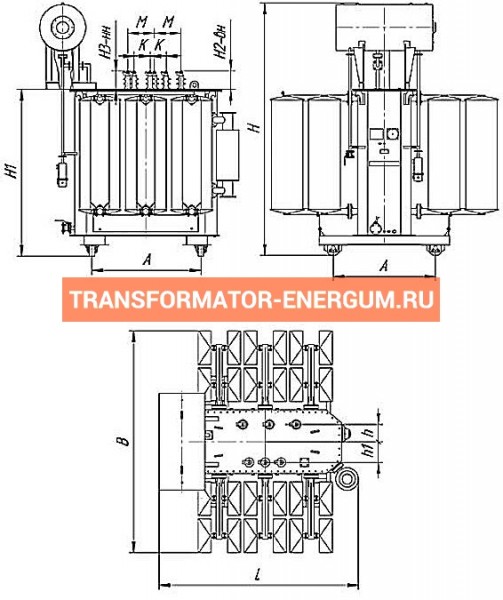

В феррорезонансном трансформаторе используется уникальная магнитная структура, в которой путь рассеяния магнитного шунта расположен между первичной и вторичной обмотками. Данная конструкция показана на рис. 2. Таким образом, только часть конструкции трансформатора насыщается при более высоком пиковом уровне напряжения во время каждого полуцикла переменного тока. Когда часть сердечника магнитно насыщается, первичная и вторичная обмотки становятся эффективно развязаны. Конденсатор переменного тока на стороне вторичной обмотки вступает в резонанс с имеющейся индукцией. Это обеспечивает перенос энергии на нагрузку во время данного этапа магнитного насыщения, поддерживая уровень напряжения. Результирующая форма волны — это обрезанная синусоида с достаточно высоким уровнем нелинейного искажения в качестве результата. Однако некоторые современные конструкции содержат дополнительную фильтрацию, которая может снижать нелинейное искажение на несколько процентов.

Это обеспечивает перенос энергии на нагрузку во время данного этапа магнитного насыщения, поддерживая уровень напряжения. Результирующая форма волны — это обрезанная синусоида с достаточно высоким уровнем нелинейного искажения в качестве результата. Однако некоторые современные конструкции содержат дополнительную фильтрацию, которая может снижать нелинейное искажение на несколько процентов.

Рис. 2. Конструкция феррорезонансного трансформатора

Помимо регулирования выходного напряжения феррорезонансный трансформатор имеет еще ряд привлекательных характеристик:

- обеспечивает защиту от бросков напряжения переменного тока в линии;

- создает защиту от мгновенных провалов в линии переменного тока;

- ограничивает свой выходной ток в случае короткого замыкания;

- очень прочен и надежен.

Однако из-за некоторых негативных побочных эффектов маловероятно найти феррорезонансные трансформаторы в современных ИП постоянного тока. Конструкции с коммутацией по высокой частоте доминируют по эксплуатационным характеристикам и стоимости. К негативным побочным эффектам конструкции феррорезонансных трансформаторов относятся:

Конструкции с коммутацией по высокой частоте доминируют по эксплуатационным характеристикам и стоимости. К негативным побочным эффектам конструкции феррорезонансных трансформаторов относятся:

- большой физический размер;

- относительно высокая стоимость и отсутствие универсальности;

- ограниченность определенной частотой линии, при которой возникает резонанс.

Несмотря на отсутствие феррорезонансных трансформаторов в большинстве современных ИП постоянного тока, очень интересно наблюдать за устойчивой потребностью в феррорезонансных трансформаторах. Сложно конкурировать с присущей им простотой и надежностью, когда определяющую роль играет длительная надежная эксплуатация с минимальным объемом технического обслуживания и регулирование линий переменного тока во многих регионах по всему миру не может осуществляться надлежащим образом.

Удаление входного трансформатора усилителя Tube Guitar

Вы писали: «гул уменьшается и отключается, когда я выключаю горшок громкости, поэтому источник шума должен быть перед горшком громкости».

Я бы проверил несколько вещей.

1) Запустите стиральную машину и физически переместите усилитель. Переместите его в другое место в комнате и в другие комнаты. Если вы попали в место, где шум самый громкий, поверните усилитель во всех возможных направлениях. Изменяется ли шум при перемещении и / или вращении усилителя?

Сделайте то же самое в месте, где шум минимален. Вызывает ли изменение шума перемещение или вращение усилителя?

Сообщите нам, если это так; не беспокойтесь о пунктах (2) и (3) ниже.

2) Является ли ваш трансформатор преобразования напряжения изолирующим или нет? Подключите один провод мультиметра к переменному напряжению к внешнему заземлению. Проверьте напряжение между заземлением и заземлением цепи. Существует большая вероятность того, что заземление цепи составляет около 120 В переменного тока над землей.

Если это так, замените провода, если необходимо, чтобы заземление цепи было как можно ближе к заземлению. То есть: вы хотите, чтобы заземление цепи было подключено к входному нейтральному, если силовой трансформатор является автотрансформатором.

Запустите стиральную машину и прислушайтесь к шуму.

3) Шум, который вы улавливаете во время работы стиральной машины, подозрительно напоминает шум привода переменной частоты. Попробуйте отсоединить вторичную обмотку входного трансформатора с верхней стороны регулятора громкости и просто дайте входу кастрюли плавать. Слушай за шум.

Если шум отсутствует, даже если регулятор громкости широко открыт, попробуйте следующий тест. Примечание: это может быть очень опасно. Это только для целей тестирования!

Закрепите один конец гитарного шнура, чтобы он был полностью изолирован. Вы не сможете подключить его к своей гитаре, но это нормально.

Теперь аккуратно используйте зажимы аллигатора, чтобы подключить гитарный шнур к цепи. Экран штекера телефона переходит на заземление, а кончик штекера телефона переходит в верхний конец регулятора громкости. Запустите стиральную машину и прислушайтесь к шуму.

Обратите внимание, что если заземление цепи подключено непосредственно к клемме Hot (Line) вашего источника переменного тока, заземление цепи LIVE и гитарный шнур тоже. Вот почему вы очень осторожны, а также почему вы приклеили свободный конец гитарного шнура.

Вот почему вы очень осторожны, а также почему вы приклеили свободный конец гитарного шнура.

Обратитесь к нам с результатами этих испытаний и сообщите нам, что вы найдете.

Входные многообмоточные трансформаторы для многоуровневых преобразователей частоты | Хакимьянов

1. Федотов А.Б., Токмаков Д.А., Левшин В.П., Шабанов В.А. Проект «Разработка и организация серийного производства ВЧРП» – цель, назначение и ос-новные ожидаемые результаты // Электротехнологии, электропривод и электрооборудование предприятий: сборник научных трудов III Всероссийской научно-технической конференции (с международным участием) / редкол.: В.А. Шабанов и др. Уфа: Изд-во УГНТУ, 2011. С. 3-10.

2. Гузеев Б.В., Хакимьянов М.И. Обзор современных высоковольтных пре-образователей частоты для асинхронных и синхронных двигателей // Электротехнологии, электропривод и электрооборудование предприятий: сборник научных трудов III Всероссийской научно-технической конференции (с международным участием) / редкол. : В.А. Шабанов и др. Уфа: Изд-во УГНТУ, 2011. С. 42-53.

: В.А. Шабанов и др. Уфа: Изд-во УГНТУ, 2011. С. 42-53.

3. Гузеев Б.В., Хакимьянов М.И. Современные промышленные высоковольтные преобразователи частоты для регулирования асинхронных и синхронных двигателей // Электронный научный журнал «Нефтегазовое дело». 2011. № 3. С. 441 — 449. URL: http://www.ogbus.ru/authors/Guzeev/Guzeev_1.pdf

4. Patent US6340851. Modular transformer arrangement for use with multilevel power converter / Rinaldi P.M., Thaxton E.S., Castles G. Filing date: Dec 28, 1999. Issue date: Jan 22, 2002.

5. Патент № 2396625 РФ. Трансформатор / Казаков В.В., Вафин Ш.И. Заявка: 11.12.2008. Опубликован: 10.08.2010.

6. Шабанов В.А., Алексеев В.Ю. Электроснабжение нефтеперекачивающих станций магистральных нефтепроводов: учебное пособие. Уфа: ООО «Монография», 2010. 272 с.

7. Меньшов Б.Г., Ершов М.С., Яризов А.Д. Электротехнические установки и комплексы нефтегазовой промышленности: учебник для вузов. М.: Недра, 2000. 487 с.

487 с.

8. Патент на полезную модель № 122215 РФ. Статический многоуровневый преобразователь частоты для питания синхронных электродвигателей / Шабанов В.А., Хакимьянов М.И., Бондаренко О.В. Дата подачи заявки: 08.06.2012. Опубликовано: 20.11.2012.

Схема фабричного лампового усилителя УП8-1 (9Вт)

В нашем обзоре мы почти не касались схем фабричных усилителей, считая их мало полезными радиолюбителю. Однако не так давно заводом № 2 НКС (быв. Профрадио) выпущен усилитель УП8-1, довольно оригинальной конструкции, знакомство с которой будет небесполезно радиолюбителю {так как многие радиолюбители

Принимают участие в работе транс-, узлов). Некоторые детали этого усилителя могут послужить образцом при конструировании различной аппаратуры.

Принципиальная схема

Схема усилителя приведена на рис. 1.

Рис. 1. Принципиальная схема фабричного лампового усилителя УП8-1 (9Вт).

Усилитель УП8-1 состоит из трех каскадов усиления на трансформаторах, причем два последние пушпульные, из них выходной каскад мощный (в плечи усилителя включены параллельно по 3 лампы).

Применение в УП8-1 второго пушпульного каскада имеет ряд преимуществ; основное это то, что при пушпуле на работу не влияют пульсации (фон) источников -питания и облегчается конструирование трансформаторов низкой частоты, так как в пушпуле не сказывается «а работе трансформаторов подмагничивающее действие анодного тока ламп, ибо ток одной лампы течет навстречу другой.

УП8-1 имеет 3 входа: для усиления от адаптера или приемника, для усиления от микрофона и от фотокаскада (в звуковом кино). Переключатель входа (3) включает ту или иную цепь, подлежащую усилению, причем этот переключатель двойной и при переключении входа (в то время когда основной движок находится в промежуточном положении) замыкает цепь сетку-нить первой лампы во избежание возможных при переключении шумов.

Напряжение, даваемое адаптером или приемником, несколько выше, чем при работе от микрофона или фотокаскада, поэтому для предотвращения возможной перегрузки усилителя и появления связанных с этим искажений, с потенциометра (8 и 6) берется только часть этого напряжения.

Поступившее на вход усилителя напряжение разделяется сопротивлением (25) и конденсатором (16) на постоянную и переменную составляющую, из которых последняя через регулятор громкости (7 и 4) попадает на входной трансформатор (21) и далее на сетку первой лампы.

Со входным трансформатором индуктивно связана компенсационная катушка (28), соединенная с накалом. По этой катушке пропускается 50-ти периодный ток, наводящий в трансформаторе напряжение обратной фазы, чем и уничтожает фон усилителя («клин клином вышибают»).

На этот способ. уничтожения фона мы обращаем-внимание радиолюбителей, ведущих борьбу с ним.

В остальной части УП8-1 мало чем отличается от обычного усилителя низкой частоты.

Сопротивление (9) и конденсатор (18) составляют развязывающую цепь первой лампы.

Сопротивления (14 и 15) шунтируют вторичные обмотки трансформатора и служат для стабилизации работы усилителя. Сопротивления (11 и 12) задают отрицательное смешение на сетки,ламп, при чем они не шунтируются конденсатором, так как в этом режиме пушпула (класс А) среднее значение анодного тока не меняется.

Детали и конструкция

Усилитель УП8-1 может работать и на двух лампах в выходном каскаде; в этом случае сопротивление смещения (12) увеличивается — размыканием части его. В анодной цепи всех ламп находятся штеккер-ные гнезда, позволяющие с помощью прибора со штеккером измерить анодный ток любой лампы.

Поскольку неизвестна нагрузка, на которую придется работать усилителю, вторичная обмотка выходного. трансформатора (24) имеет 4 вывода, подбираемых это нагрузке, т. е. по громкоговорителям.

УП8-1 может питаться как от сети переменного тока через выпрямитель, так и от аккумуляторных батарей.

Лампы для УП8-1 :І и II каскады СО-118 и III выходной каскад УО-104.

Мощность УП8-1 при 6 лампах УО-104 в оконечном каскаде составляет около 8— 9 ватт, и при двух лампах— около 3 ВТ.

Данные схемы усилителя УП8-1 таковы:

Трансформатор входа Тр-48 (21) собран на железе Ш-25, толщина сердечника 35 мм, толщина пластинки железа 0,35 мм, сечение сердечника 7,5 см^2. Трансформатор имеет две обмотки — первичная в 1200 витков намотана из провода 0,3 и состоит из 6 секций по 210 витков в каждой. Общее сопротивление обмотки 60— 70 ом.

Трансформатор имеет две обмотки — первичная в 1200 витков намотана из провода 0,3 и состоит из 6 секций по 210 витков в каждой. Общее сопротивление обмотки 60— 70 ом.

Вторичная обмотка имеет 15900 витков и также состоит из 6 секций по 2 650 витков в каждой; общее сопротивление -обмотки 11300 ом.

Между ламповый трансформатор Тр-49 (22): железо Ш-25, сечение сердечника 7,5 см2. Первичная обмотка имеет 12 000 витков провода ПЭ — 0,12 мм и состоит из 6 секций по 2 000 витков каждая; сопротивление обмотки — 3750 ом. Вторичная обмотка имеет 24 000 витков (с выводом от середины) из провода ПЭ-0,08 мм, количество секций 5 по 4 800 витков в каждой; сопротивление обмотки—17 000 ом.

Данные и конструкция междудампового трансформатора Тр-50 (23) те же, что и у Тр-49.

Первичная обмотка этого трансформатора имеет вывод от середины.

Во всех этих трансформаторах применена секционная намотка в целях уменьшения самоиндукции рассеяния. Кроме того, в случае обрыва вместо перемотки всего трансформатора здесь можно обойтись заменой одной дашь (поврежденной) секции.

Выходной .трансформатор Тр-51 (24): железо Ш-25, толщина железа 0,35 мм, толщина сердечника 50 мм, чистое сечение его 12 см2. Первичная обмотка имеет 1200 витков провода ПШД 0,23 мм с отводом от 600 витка. Намотана она на 2-секционном каркасе. Сопротивление обмотки 92 ом. Вторичная его обмотка разбита на 4 части из них:

Железо сердечника всех трансформаторов собирается в перекрышку.

Регулятор громкости (4) на 20 ступеней регулировки.

Переключатель входа (5) на 3 положения служит для включения напряжения накала и анода.

Сопротивление (6) 400 ом, намотано из никелина 0,-1 мм; сопротивление на входе адаптера (8) в 10 000 ом Каминского служит для понижения напряжения, даваемого адаптером; сопротивление смещения 1-го каскада (10)—1330 ом намотано на деревянном каркасике; сопротивление смещения 2-го каскада (11) в 670 ом намотано из никелина ПШД 0,08 мм на деревянном каркасике; сопротивление смещения сетки 3-го. каскада (12) в 570 ом (190 и 380 ом) намотано из никелина 0,3 мм ПШД на пертинаксовой планке.

При 2 лампах в пушпуле включается 570 ом, а при 6 лампах— только 190 ом.

Сопротивление средней точки накала (13) в 20 ом с отводом от середины намотано из никелина ПШД 0,3 мм.

Сопротивление (9)— 15000 ом типа Каминского . Сопротивление С14) — 200000 ом типа Каминского — 2 шт.

Сопротивление (15) — 500 000 ом типа Каминского — 2 шт.

Сопротивление (’19) и (20) около 100 ом и служит шунтом к прибору ЭМ и подгоняется индивидуально к прибору.

Сопротивление (25) равно 950 ом, причем часть его (275 ом) намотана из медной проволоки диаметром ПЭ 0,09 мм, а остальная часть из никелина 0,1 мм.

Сопротивление (30) порядка 50 000 ом добавочное к вольтметру.

Компенсационная катушка (28) состоит из 100 витков ПШД 0,15 мм и 3 витков никелина 0,1 мм, общее сопротивление ее 25 ом.

Конденсатор (16) в 2,5 мкф (пробивное напряжение 400 вольт) не пропускает постоянную слагающую, во избежание тресков при переключении регулятора громкости.

Конденсатор (17) в 2 мкф блокирует сеточное смещение 1-го каскада; конденсатор (18) в 2 мкф (пробивное „ напряжение 1 ООО в) является конденсатором фильтра, вынесенным из выпрямителя.

Более подробно УП8-1 описан в № 17 «РФ» за 1934 г. и «Техника Связи» № 10 за 1933 г.

Источник: Ф. Бурдейный, В. Забелло. М. Эфрусси — Радиолюбительские схемы.

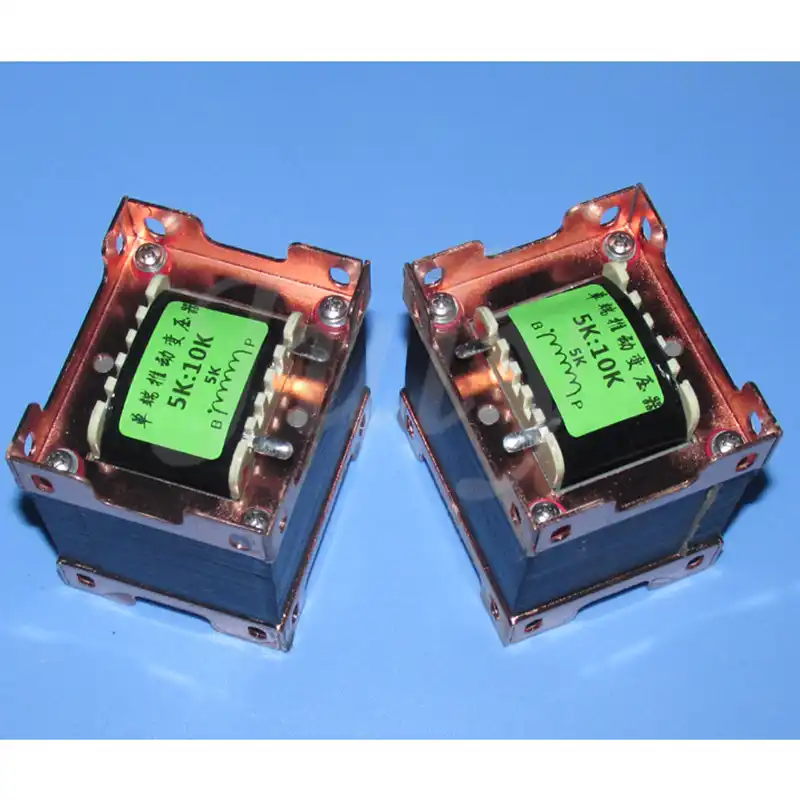

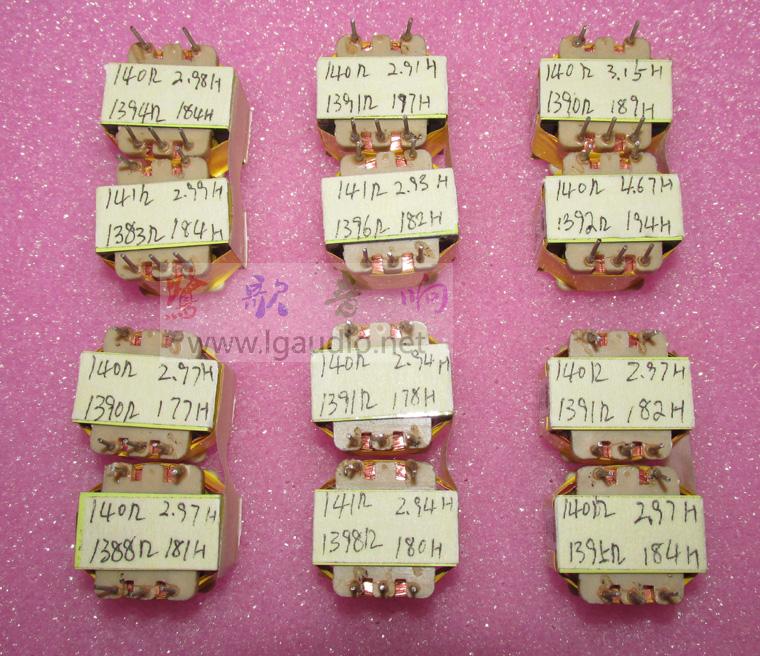

Влияние трансформатора в преде на звук

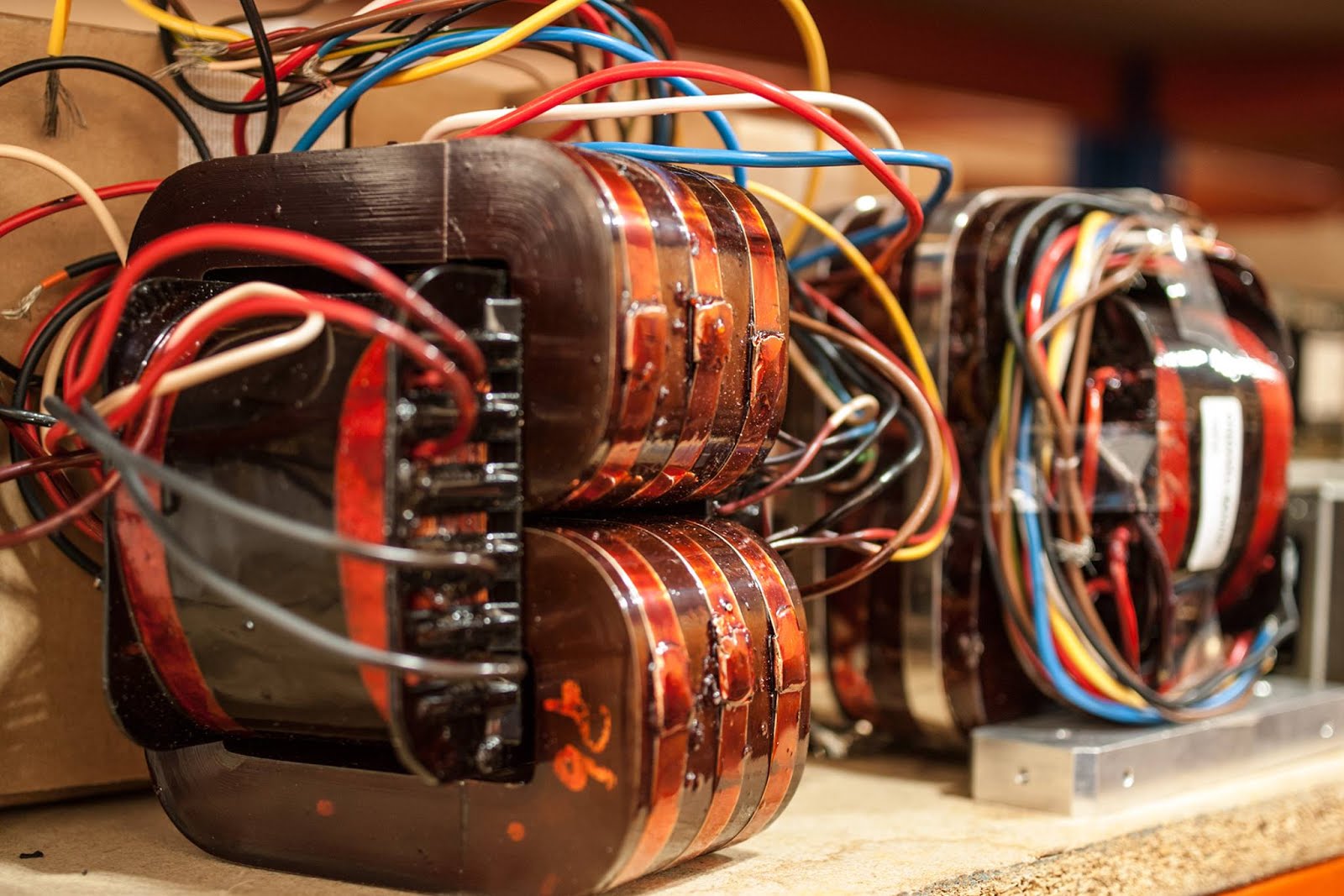

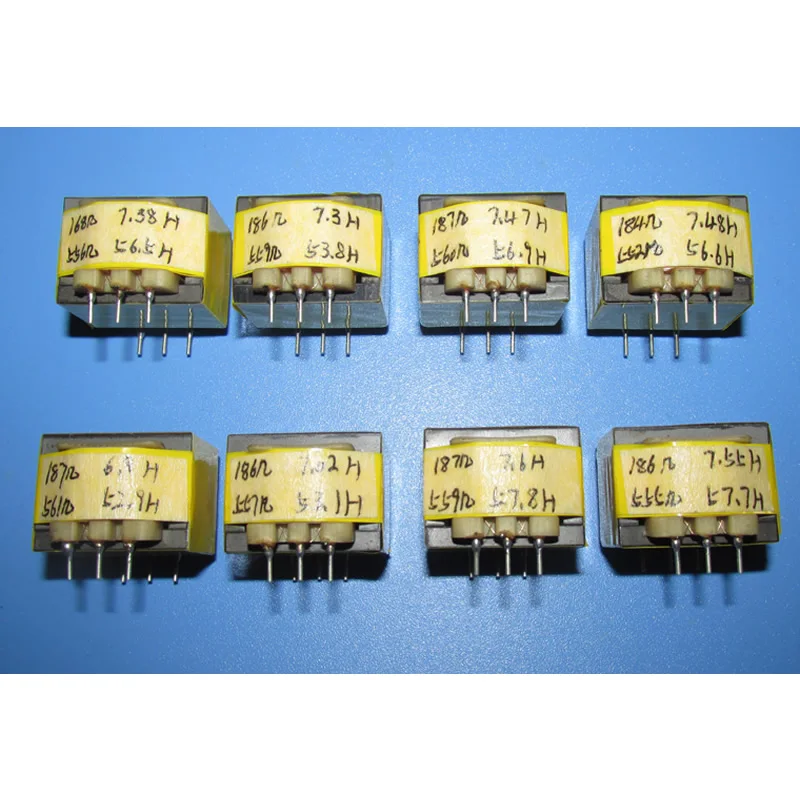

пару месяцев назад мне привозили на тесты старые аудио-трансформаторы, выковырянные из старого оборудования. Трансы разного размера, разные сердечники, разное количество обмоток. Цепочка для прослушивания: ЦАП-транс-АЦП.Это глюк или так и должно быть?

характер звука каждого трансформатора отличается кардинально:

• большие трансы ЛОМО размером с кулак (трансформация 1:4) раздували верх и низ, звучали превосходно.

• другие трансы из венгерского оборудования размером приблизительно 3х3х3см вообще съедали и размазывали верх, но шикарная середина, и голоса через этот транс звучат очень кайфово. При том, что это повышающие трансы 1:7 и их лучший звук получается в повышающем подключении, когда в понижающем подключении эффект не столь приятный.

• какие то трансы звучат как кусок медного провода т.е. никак, на слух изменений нет. Для моих задач это «бестолковые» трансы.

• какие-то маленькие трансики конкретно съедали низ и воздушно искрили по верхам — они прям убивают голос и страшно пердят и хрюкают от баса и бочки, но при этом, буквально вселяют жизнь в хэты, тарелки, шейкеры, колокольчики и т.п. И этот эффект не похож на простое задирание верха эквалайзером, эффект не похож на металлический эксайтер. Сложно сказать, что происходит, просто верхастые звуки облагораживаются и становятся приятны уху, но любые другие типы сигналов в этих трансах умирают.

Вам просто надо использовать другие трансы, подбирать их под свой тип сигнала. Мне лично очень интересны трансы, которые явно изменяют звук любым образом. Если Ваши трансы убивают транзиетны, они мне интересны, я могу их у Вас купить или можем поменяться, могу Вам дать трансы которые «как кусок медного провода» т.е. своего звукового характера не имеют, точно не съедают транзиенты, в «слепом тесте» не могу их услышать, да чего уж там. . я даже в «зрячем тесте» разницу не слышу. И если трансы Вам нужны скорее из технических соображений (согласование, гальваническая развязка) и нужна сохранность звука, то эти чистые трансы могут Вам подойти. А мне, в свою очередь, интересны любые звуковые трансы со своей харизмой. Так что можем махнуться.

. я даже в «зрячем тесте» разницу не слышу. И если трансы Вам нужны скорее из технических соображений (согласование, гальваническая развязка) и нужна сохранность звука, то эти чистые трансы могут Вам подойти. А мне, в свою очередь, интересны любые звуковые трансы со своей харизмой. Так что можем махнуться.

: используйте входной трансформатор, чтобы настроить, что EventBridge передает в цель события

Сервисы или возможности, описанные в документации Amazon Web Services, могут отличаться по региону. Чтобы увидеть различия, применимые к регионам Китая, см. Начало работы с веб-службами Amazon в Китае. Вы можете использовать входной трансформатор в EventBridge

чтобы настроить текст события перед его отправкой

цель правила.

Для этого вы определяете пути JSON от события и назначаете их выходы разным переменные. Затем вы можете использовать эти переменные в шаблоне ввода. Персонажи <и > не сбежать. Для получения дополнительной информации см. Преобразование целевого входа Amazon EventBridge

.Если вы укажете переменную для соответствия пути JSON, который не существует в событии, это переменная не создается и не отображается в выводе.

В этом руководстве вы создаете правило, которое запускается при изменении состояния любого экземпляра. Ты

извлекать

идентификатор экземпляра и указывают экземпляра Amazon EC2 из события. Затем вы используете входной трансформатор, чтобы поместить эти данные в сообщение, которое отправляется в

социальная сеть Amazon

тема.В

Затем вы используете входной трансформатор, чтобы поместить эти данные в сообщение, которое отправляется в

социальная сеть Amazon

тема.В

Например, правило в этом руководстве соответствует следующему изменению состояния инстанса Amazon EC2. событие уведомления.

{

"id": "7bf73129-1428-4cd3-a780-95db273d1602",

"detail-type": "Уведомление об изменении состояния экземпляра EC2",

"источник": "aws.ec2",

"account": "123456789012",

"time": "2015-11-11T21: 29: 54Z",

"регион": "нас-восток-1",

"Ресурсы":[

"arn: aws: ec2: us-east-1: 123456789012: instance / i-1234567890abcdef0"

],

"деталь": {

"instance-id": "i-1234567890abcdef0",

"состояние": "остановлено"

}

} Входной преобразователь преобразует переменную экземпляра в $. Путь JSON от события и состояние  detail.instance-id

detail.instance-id в путь $ .detail.state JSON. Затем EventBridge помещает переменные в

шаблон ввода «Экземпляр EC2 <экземпляр> изменил состояние на <состояние>». В

Результатом является следующее сообщение Amazon SNS.

Экземпляр EC2 i-1234567890abcdef0 изменил состояние на остановленное. Шаг 1. Создайте правило

Создайте правило для использования входного преобразователя для настройки информации о состоянии экземпляра что идет к цели.

Для создания правила

Откройте консоль Amazon EventBridge по адресу https: // console.

amazonaws.cn/events/.

amazonaws.cn/events/.На панели навигации выберите Правила .

Выберите Создать правило .

Введите имя и описание правила.

Для Определите шаблон , сделайте следующее:

Выберите Шаблон события .

Выберите Шаблон, предварительно определенный службой .

Для Поставщик услуг выберите Амазонка .

Для Имя службы выберите EC2 .

Для Тип события выберите Экземпляр EC2. Уведомление об изменении состояния .

Выбрать Любое состояние , Любое экземпляр .

Для Выберите шину событий , выберите Amazon по умолчанию автобус событий .

Когда сервис Amazon в вашей учетной записи генерирует событие, он переходит в шину событий вашего аккаунта по умолчанию.

Для Target выберите тему SNS .

Для темы выберите тему Amazon SNS, для которой требуется уведомление. при изменении состояния инстансов Amazon EC2.

Выбрать Настроить вход , Вход Трансформатор .

Для Input Path введите {"state": "$.detail.state "," instance ":" $ .detail.instance-id "} .

Для шаблона ввода введите "Экземпляр EC2 <экземпляр> изменил состояние на <состояние>."

Выберите Создать .

Шаг 2: Подтвердите успех

Если вы видите правило в списке правил, вы успешно создали правило.

Шаг 3. Очистите свои ресурсы

Теперь вы можете удалить ресурсы, созданные для этого руководства, если вы не хотите

чтобы сохранить их. Удаляя ресурсы Amazon, которые вы больше не используете, вы предотвращаете

ненужные платежи на вашу учетную запись Amazon.

Для удаления правил EventBridge

Откройте страницу правил консоли EventBridge.

Выберите правила, которые вы создали.

Выберите Удалить .

Выберите Удалить .

Входной трансформатор

Входной трансформатор срабатывает при каждом сообщении от пользователя перед выполнением потока. Это позволяет манипулировать текстом до того, как он будет отправлен в поток, общаться с внешними системами, реализовывать интеграцию с новым каналом и многое другое.

Входной трансформатор конфигурируется путем реализации функции handleInput в трансформаторе в конечной точке.

Функция handleInput получает объект конфигурации в качестве аргумента. Этот объект всегда содержит ключ конечной точки , который содержит конфигурацию конечной точки. Остальные ключи в объекте зависят от базового типа Трансформатора. Обзор ключей в объекте можно увидеть ниже

Обзор ключей в объекте можно увидеть ниже

Аргумент | Описание | Трансформаторы Webhook | Трансформаторы REST | Концевые трансформаторы | конечная точка объектаСодержит URLToken и т. Д. | X | X | X |

|---|---|---|---|---|

request | Объект экспресс-запроса с разобранным телом JSON. | X | X | |

ответ | Объект экспресс-ответа. | X | X | |

полезная нагрузка | Объект полезной нагрузки содержит userId, sessionId, текст и данные, которые были отправлены через Socket.Он также содержит канал клиента. | X |

Входной преобразователь может возвращать действительный идентификатор пользователя, идентификатор сеанса, текст и / или данные, которые должны быть отправлены в поток. Эти значения должны быть извлечены из тела запроса. Важно отметить, что формат тела запроса будет отличаться в зависимости от конкретного используемого канала, то есть запрос от Alexa выглядит совсем иначе, чем запрос от Facebook Messenger.Следовательно, необходимо прочитать документацию по конкретному каналу, чтобы узнать, как отформатировано тело запроса.

Эти значения должны быть извлечены из тела запроса. Важно отметить, что формат тела запроса будет отличаться в зависимости от конкретного используемого канала, то есть запрос от Alexa выглядит совсем иначе, чем запрос от Facebook Messenger.Следовательно, необходимо прочитать документацию по конкретному каналу, чтобы узнать, как отформатировано тело запроса.

Пример:

возврат {

userId: request.body.user,

sessionId: request.body.conversation,

текст: request.body.messageText,

data: {"test": 1}

};

Если undefined возвращается для userId, sessionId, текста или данных, используется уже извлеченное значение из конечной точки.

Следующий пример перезаписывает текст и данные , но сохраняет userId и sessionId как есть:

возврат {

userId: undefined,

sessionId: undefined,

текст: запрос. body.messageText,

data: {"test": 1}

};

body.messageText,

data: {"test": 1}

};

Если входной трансформатор вообще возвращает ложное значение, то сообщение от пользователя никогда не отправляется в поток.

Пример:

return null;

разговоров в Cognigy.AI засчитываются только в том случае, если входной преобразователь возвращает не ложный результат.

🚧

Проверка возвращаемого значения

Возвращаемое значение входного трансформатора

, если оно предусмотрено, проверяется на соответствие набору правил и отклоняется, если правила не выполняются.

Каждое значение может возвращать неопределенное значение. Если возвращается что-то еще, применяются следующие правила:

- userId - это строка с максимальной длиной 256 символов.

- sessionId - это строка с максимальной длиной 256 символов.

Текст- - это строка длиной не более 10000 символов.

- данные - это объект

Вход и выход трансформатора | IOPSpark

Энергия, передаваемая при работе

Электричество и магнетизм

Трансформатор входной и выходной

Повествование о физике для 14-16

Закон Ленца

Сохранение энергии - очень фундаментальный принцип: энергия, переданная из одного хранилища, равна энергии, переданной в другие хранилища.

Power in pathways также соблюдает этот принцип, поскольку ни одно устройство не может делать больше, чем переключать каналы: выходная мощность не может быть больше, чем входная мощность.

Если вы предлагаете процесс, в котором появляется больше власти, чем вы вкладываете, вы наверняка ошибаетесь. Итак, если есть только две возможности, и вы исключаете одну, другая должна быть верной. Таким образом определяется взаимосвязь между направлением потока в выходной катушке и изменяющимся потоком во входной катушке.Мы показываем, что одна возможность нарушает закон сохранения энергии, а затем заключаем, что другая возможность должна быть верной.

Итак, если есть только две возможности, и вы исключаете одну, другая должна быть верной. Таким образом определяется взаимосвязь между направлением потока в выходной катушке и изменяющимся потоком во входной катушке.Мы показываем, что одна возможность нарушает закон сохранения энергии, а затем заключаем, что другая возможность должна быть верной.

Итак, поработаем: описать то, что оказалось невозможным.

Аргументы о сохранении энергии

Рассмотрим входной электрический контур с увеличивающимся потоком и, таким образом, создающий увеличивающийся магнитный эффект в соединительном контуре. На выходном электрическом контуре будет наведена постоянная разность потенциалов. Это может быть только в одном из двух направлений.Эта разность потенциалов будет управлять электрическим током, который также создает магнитное поле и, следовательно, магнитный эффект. Одно направление будет производить магнитный эффект, который добавляется к существующему эффекту, создаваемому входной катушкой. В этом случае изменение магнитного эффекта индуцирует разность потенциалов, которая возбуждает ток, который увеличивает магнитный эффект, что приводит к индуцированию большей разности потенциалов и, следовательно, к большему возбужденному току на выходе. Цикл положительной обратной связи продолжается без ограничений.Теперь выходная катушка имеет растущую разность потенциалов и растущий ток, поэтому в цепи больше мощности ( P = I × V ). Это без внесения каких-либо изменений во ввод. Теперь вы получаете что-то даром, и больше нет компенсации в изменении характера пути: как разность выходных потенциалов, так и выходной ток растут.

В этом случае изменение магнитного эффекта индуцирует разность потенциалов, которая возбуждает ток, который увеличивает магнитный эффект, что приводит к индуцированию большей разности потенциалов и, следовательно, к большему возбужденному току на выходе. Цикл положительной обратной связи продолжается без ограничений.Теперь выходная катушка имеет растущую разность потенциалов и растущий ток, поэтому в цепи больше мощности ( P = I × V ). Это без внесения каких-либо изменений во ввод. Теперь вы получаете что-то даром, и больше нет компенсации в изменении характера пути: как разность выходных потенциалов, так и выходной ток растут.

Вывод: должно быть обратное. Разность потенциалов на выходе должна быть такой полярности, чтобы возбуждаемый ток создавал магнитный эффект, уменьшающий индуцирующий магнитный эффект.

Начало с уменьшением электрического потока в первичной обмотке изменяет все знаки в аргументе и снова приводит к выводу, что магнитный эффект, создаваемый током, вызванным индуцированной разностью потенциалов в выходном контуре, должен иметь такое направление, чтобы он противодействует любым изменениям магнитного эффекта.

Этот результат известен как закон Ленца, но теперь вы можете видеть, что на самом деле это просто закон сохранения энергии. В дальнейших исследованиях мы просто напишем:

наведенная разность потенциалов = - постоянная × изменение магнитного эффекта.

Иногда простой знак минус означает множество физических рассуждений.

Входы и выходы для трансформаторов

Переменная разность потенциалов - это разность потенциалов, которая многократно меняет полярность, управляя электрическим током сначала в одну сторону, а затем в другую. Отслеживание изменений во времени может дать любое количество паттернов, но при этом они будут чередоваться (возможны пилообразные, наклонные и прямоугольные волны).

Питание от сети синусоидальное, поэтому стоит подумать, как это работает в трансформаторе.Мы думаем, что лучше всего выбрать несколько моментов для размышления, чтобы предсказать, как изменяющаяся связь повлияет на индуцированную разность потенциалов.

Когда ток во входном электрическом контуре невелик, но быстро растет, магнитный эффект в соединительном контуре также быстро растет, поэтому наведенная разность потенциалов велика и отрицательна.

Ток в одном электрическом контуре, связанный с разностью потенциалов во втором

Когда ток во входном электрическом контуре имеет максимальное положительное значение (больше не растет), магнитный эффект в соединительном контуре также велик, но больше не растет, поэтому наведенная разность потенциалов равна нулю.

Когда ток во входном электрическом контуре невелик, но быстро сокращается, магнитный эффект в соединительном контуре также быстро уменьшается, поэтому наведенная разность потенциалов большая и положительная.

Когда ток во входном электрическом контуре имеет максимальное отрицательное значение (больше не растет), магнитный эффект в соединительном контуре также велик, но больше не растет, поэтому наведенная разность потенциалов равна нулю.

Некоторые из этих точек, теперь мы можем заполнить график, чтобы показать, что наведенная разность потенциалов также синусоидальная (так что ток в выходном электрическом контуре тоже будет), но что он не достигает пика одновременно с Вход.Мы говорим, что входной ток на не соответствует фазе

с наведенной разностью потенциалов.

The Illustrated Transformer - Джей Аламмар - Визуализация машинного обучения по одной концепции за раз.

Обсуждения:

Hacker News (65 баллов, 4 комментария), Reddit r / MachineLearning (29 баллов, 3 комментария)

Переводы: Испанский, Китайский (упрощенный), Корейский, Русский, Вьетнамский, Французский, Японский

Смотреть: лекция MIT по теме «Глубокое обучение» со ссылкой на этот пост

В предыдущем посте мы рассмотрели «Внимание» - повсеместный метод в современных моделях глубокого обучения.Внимание - это концепция, которая помогла повысить производительность приложений нейронного машинного перевода. В этом посте мы рассмотрим The Transformer - модель, которая привлекает внимание для повышения скорости обучения этих моделей. Трансформеры превосходят модель нейронного машинного перевода Google в определенных задачах. Однако наибольшее преимущество заключается в том, что The Transformer позволяет распараллеливать. Фактически, Google Cloud рекомендует использовать The Transformer в качестве эталонной модели для использования своего предложения Cloud TPU.Итак, давайте попробуем разбить модель на части и посмотрим, как она работает.

В этом посте мы рассмотрим The Transformer - модель, которая привлекает внимание для повышения скорости обучения этих моделей. Трансформеры превосходят модель нейронного машинного перевода Google в определенных задачах. Однако наибольшее преимущество заключается в том, что The Transformer позволяет распараллеливать. Фактически, Google Cloud рекомендует использовать The Transformer в качестве эталонной модели для использования своего предложения Cloud TPU.Итак, давайте попробуем разбить модель на части и посмотрим, как она работает.

Трансформатор был предложен в статье "Внимание - это все, что вам нужно". Его реализация в TensorFlow доступна как часть пакета Tensor2Tensor. Группа НЛП из Гарварда создала руководство с аннотациями к статье с использованием PyTorch. В этом посте мы попытаемся немного упростить вещи и представить концепции одну за другой, чтобы, надеюсь, облегчить понимание людям без глубоких знаний предмета.

Обновление 2020 г. : Я создал видео «Рассказанный трансформер», в котором более мягкий подход к теме:

: Я создал видео «Рассказанный трансформер», в котором более мягкий подход к теме:

Взгляд высокого уровня

Давайте начнем с рассмотрения модели как единого черного ящика. В приложении машинного перевода оно берет предложение на одном языке и выводит его перевод на другом.

Раскрывая эту доброту Оптимуса Прайма, мы видим компонент кодирования, компонент декодирования и связи между ними.

Компонент кодирования представляет собой стек кодировщиков (на бумаге шесть из них складываются друг на друга - в числе шесть нет ничего волшебного, можно определенно поэкспериментировать с другими компоновками). Компонент декодирования представляет собой стек декодеров с одинаковым числом.

Все кодировщики идентичны по структуре (но у них нет общих весов). Каждый из них разбит на два подслоя:

Каждый из них разбит на два подслоя:

Входные данные кодировщика сначала проходят через слой самовнимания - слой, который помогает кодировщику смотреть на другие слова во входном предложении, когда он кодирует определенное слово.Мы подробнее рассмотрим самовнимание позже в этом посте.

Выходные данные слоя самовнимания передаются в нейронную сеть с прямой связью. Точно такая же сеть прямого распространения независимо применяется к каждой позиции.

В декодере есть оба этих уровня, но между ними есть уровень внимания, который помогает декодеру сосредоточиться на соответствующих частях входного предложения (аналогично тому, что делает внимание в моделях seq2seq).

Использование тензоров в картине

Теперь, когда мы рассмотрели основные компоненты модели, давайте приступим к рассмотрению различных векторов / тензоров и того, как они перемещаются между этими компонентами, чтобы превратить входные данные обученной модели в выходные данные.

Как и в случае с приложениями НЛП в целом, мы начинаем с превращения каждого входного слова в вектор с помощью алгоритма встраивания.

Каждое слово вложено в вектор размером 512. Мы представим эти векторы этими простыми прямоугольниками.

Встраивание происходит только в самый нижний кодировщик. Абстракция, которая является общей для всех кодировщиков, заключается в том, что они получают список векторов, каждый из которых имеет размер 512. В нижнем кодировщике это будет слово embeddings, но в других кодировщиках это будет выход кодировщика, который находится непосредственно под .Размер этого списка - это гиперпараметр, который мы можем установить - в основном это будет длина самого длинного предложения в нашем наборе обучающих данных.

После встраивания слов в нашу входную последовательность каждое из них проходит через каждый из двух уровней кодировщика.

Здесь мы начинаем видеть одно ключевое свойство преобразователя, а именно то, что слово в каждой позиции проходит свой собственный путь в кодировщике. Между этими путями на уровне самовнимания есть зависимости.Однако уровень прямой связи не имеет этих зависимостей, и, таким образом, различные пути могут выполняться параллельно при прохождении через слой прямой связи.

Между этими путями на уровне самовнимания есть зависимости.Однако уровень прямой связи не имеет этих зависимостей, и, таким образом, различные пути могут выполняться параллельно при прохождении через слой прямой связи.

Затем мы заменим пример более коротким предложением и посмотрим, что происходит на каждом подуровне кодировщика.

Теперь мы кодируем!

Как мы уже упоминали, кодировщик получает на вход список векторов. Он обрабатывает этот список, передавая эти векторы в слой «самовнимания», затем в нейронную сеть с прямой связью, а затем отправляет выходные данные вверх следующему кодировщику.

Слово в каждой позиции проходит через процесс самовнимания. Затем каждый из них проходит через нейронную сеть с прямой связью - точно такую же сеть, и каждый вектор проходит через нее отдельно.

Самовнимание на высоком уровне

Не обманывайтесь, когда я использую слово «самовнимание», как будто это понятие должно быть знакомо каждому. Я лично никогда не сталкивался с этой концепцией до тех пор, пока не прочитал статью «Все, что вам нужно». Давайте разберемся, как это работает.

Я лично никогда не сталкивался с этой концепцией до тех пор, пока не прочитал статью «Все, что вам нужно». Давайте разберемся, как это работает.

Скажем, следующее предложение является вводным предложением, которое мы хотим перевести:

” Животное не переходило улицу, потому что оно слишком устало ”

Что означает «оно» в этом предложении? Имеется в виду улица или животное? Это простой вопрос для человека, но не такой простой для алгоритма.

Когда модель обрабатывает слово «оно», самовнимание позволяет ей ассоциировать «это» с «животным».

По мере того, как модель обрабатывает каждое слово (каждую позицию во входной последовательности), самовнимание позволяет ей смотреть на другие позиции во входной последовательности в поисках подсказок, которые могут помочь улучшить кодирование этого слова.

Если вы знакомы с RNN, подумайте, как поддержание скрытого состояния позволяет RNN включать свое представление предыдущих слов / векторов, которые она обработала, с текущим, который она обрабатывает. Самовнимание - это метод, который Трансформер использует для «запекания» других релевантных слов в словах, которые мы обрабатываем в данный момент.

Самовнимание - это метод, который Трансформер использует для «запекания» других релевантных слов в словах, которые мы обрабатываем в данный момент.

Поскольку мы кодируем слово «оно» в кодировщике №5 (верхний кодировщик в стеке), часть механизма внимания фокусировалась на «Животном» и запекла часть его представления в кодировке «оно».

Обязательно ознакомьтесь с записной книжкой Tensor2Tensor, где вы можете загрузить модель Transformer и изучить ее с помощью этой интерактивной визуализации.

Самостоятельное внимание в деталях

Давайте сначала посмотрим, как вычислить самовнимание с помощью векторов, а затем перейдем к рассмотрению того, как это на самом деле реализовано - с помощью матриц.

Первый шаг при вычислении самовнимания состоит в том, чтобы создать три вектора из каждого из входных векторов кодировщика (в данном случае - вложение каждого слова).Итак, для каждого слова мы создаем вектор запроса, вектор ключа и вектор значения. Эти векторы создаются путем умножения вложения на три матрицы, которые мы обучили в процессе обучения.

Эти векторы создаются путем умножения вложения на три матрицы, которые мы обучили в процессе обучения.

Обратите внимание, что эти новые векторы меньше по размерности, чем вектор внедрения. Их размерность составляет 64, в то время как векторы ввода / вывода встраивания и кодировщика имеют размерность 512. Они НЕ ДОЛЖНЫ быть меньше, это выбор архитектуры, позволяющий сделать вычисление многогранного внимания (в основном) постоянным.

Умножение x1 на весовую матрицу WQ дает q1, вектор "запроса", связанный с этим словом. В итоге мы создаем проекцию «запроса», «ключа» и «значения» для каждого слова во входном предложении.

Что такое векторы «запроса», «ключа» и «значения»?

Это абстракции, которые полезны для вычисления внимания и размышлений о нем. После того, как вы перейдете к чтению того, как рассчитывается внимание ниже, вы будете знать почти все, что вам нужно знать о роли каждого из этих векторов.

Второй шаг при расчете самовнимательности - это подсчет баллов. Предположим, мы вычисляем внимание к себе для первого слова в этом примере - «Мышление». Нам нужно сопоставить каждое слово входного предложения с этим словом. Оценка определяет, сколько внимания следует уделять другим частям входного предложения, когда мы кодируем слово в определенной позиции.

Предположим, мы вычисляем внимание к себе для первого слова в этом примере - «Мышление». Нам нужно сопоставить каждое слово входного предложения с этим словом. Оценка определяет, сколько внимания следует уделять другим частям входного предложения, когда мы кодируем слово в определенной позиции.

Оценка рассчитывается как скалярное произведение вектора запроса на ключевой вектор соответствующего слова, которое мы оцениваем.Итак, если мы обрабатываем самовнимание для слова в позиции №1, первая оценка будет скалярным произведением q1 и k1. Вторая оценка будет скалярным произведением q1 и k2.

Третий и четвертый этапы заключаются в разделении оценок на 8 (квадратный корень из размерности ключевых векторов, используемых в статье - 64. Это приводит к получению более стабильных градиентов. Здесь могут быть другие возможные значения, но это значение по умолчанию), затем передайте результат через операцию softmax.Softmax нормализует оценки, чтобы все они были положительными и в сумме составляли 1.

Эта оценка softmax определяет, насколько каждое слово будет выражено в этой позиции. Очевидно, что слово в этой позиции будет иметь самый высокий балл softmax, но иногда полезно обратить внимание на другое слово, имеющее отношение к текущему слову.

Пятый этап заключается в умножении каждого вектора значений на показатель softmax (при подготовке к их суммированию). Интуиция здесь заключается в том, чтобы сохранить неизменными значения слов, на которых мы хотим сосредоточиться, и заглушить не относящиеся к делу слова (умножив их на крошечные числа, такие как 0.001, например).

Шестой этап предназначен для суммирования векторов взвешенных значений. Это производит вывод слоя самовнимания в этой позиции (для первого слова).

На этом расчет самовнимания завершен. Результирующий вектор - это тот, который мы можем отправить в нейронную сеть с прямой связью. Однако в реальной реализации этот расчет выполняется в матричной форме для более быстрой обработки. Итак, давайте посмотрим на это теперь, когда мы увидели интуицию вычисления на уровне слов.

Итак, давайте посмотрим на это теперь, когда мы увидели интуицию вычисления на уровне слов.

Матрица расчета самовнимания

Первым шагом является вычисление матриц запроса, ключа и значения. Мы делаем это, упаковывая наши вложения в матрицу X и умножая ее на матрицы весов, которые мы обучили (WQ, WK, WV).

Каждая строка в матрице X соответствует слову во входном предложении. Мы снова видим разницу в размере вектора встраивания (512 или 4 прямоугольника на рисунке) и векторов q / k / v (64 или 3 прямоугольника на рисунке).

Наконец, , поскольку мы имеем дело с матрицами, мы можем объединить шаги со второго по шестой в одну формулу, чтобы вычислить результаты слоя самовнимания.

Расчет самовнимания в матричной форме

Многоголовый зверь

В статье дополнительно усовершенствован слой самовнимания, добавлен механизм, называемый «многоголовым» вниманием. Это улучшает производительность слоя внимания двумя способами:

Расширяет способность модели фокусироваться на разных позициях.

Да, в приведенном выше примере z1 содержит немного любой другой кодировки, но в ней может преобладать само слово.Было бы полезно, если бы мы переводили предложение вроде «Животное не перешло улицу, потому что оно слишком устало», мы хотели бы знать, к какому слову «оно» относится.

Да, в приведенном выше примере z1 содержит немного любой другой кодировки, но в ней может преобладать само слово.Было бы полезно, если бы мы переводили предложение вроде «Животное не перешло улицу, потому что оно слишком устало», мы хотели бы знать, к какому слову «оно» относится.Он дает слою внимания несколько «подпространств представления». Как мы увидим далее, с многоголовым вниманием у нас есть не только один, но и несколько наборов весовых матриц запроса / ключа / значения (преобразователь использует восемь головок внимания, поэтому мы получаем восемь наборов для каждого кодировщика / декодера). . Каждый из этих наборов инициализируется случайным образом.Затем, после обучения, каждый набор используется для проецирования входных вложений (или векторов из нижних кодировщиков / декодеров) в другое подпространство представления.

С многоголовым вниманием мы поддерживаем отдельные весовые матрицы Q / K / V для каждой головы, в результате чего получаются разные матрицы Q / K / V.

Как и раньше, мы умножаем X на матрицы WQ / WK / WV, чтобы получить матрицы Q / K / V.

Как и раньше, мы умножаем X на матрицы WQ / WK / WV, чтобы получить матрицы Q / K / V.

Если мы проделаем тот же расчет самовнимания, который мы описали выше, всего восемь раз с разными весовыми матрицами, мы получим восемь разных Z-матриц

Это оставляет нам небольшую проблему.Слой прямой связи не ожидает восьми матриц - он ожидает единственную матрицу (вектор для каждого слова). Итак, нам нужен способ сжать эти восемь элементов в единую матрицу.

Как мы это делаем? Мы объединяем матрицы, а затем умножаем их на дополнительную матрицу весов WO.

Вот и все, что нужно для многоглавого самовнимания. Я понимаю, что это довольно много матриц. Позвольте мне попытаться объединить их все в один визуальный ряд, чтобы мы могли рассматривать их в одном месте

Теперь, когда мы коснулись головок внимания, давайте вернемся к нашему предыдущему примеру, чтобы увидеть, на чем фокусируются различные головы внимания, когда мы кодируем слово «оно» в нашем примере предложения:

Когда мы кодируем слово «оно», одна голова внимания больше всего сосредотачивается на «животном», а другая - на «усталом» - в некотором смысле, представление модели слова «оно» вписывается в некоторые из представлений.

как "животное", так и "уставшее".

как "животное", так и "уставшее".Однако, если мы добавим все внимание к изображению, интерпретировать вещи будет сложнее:

Представление порядка последовательности с использованием позиционного кодирования

В модели, которую мы описали до сих пор, отсутствует одна вещь, так это способ учесть порядок слов во входной последовательности.

Чтобы решить эту проблему, преобразователь добавляет вектор к каждому встраиванию входа. Эти векторы следуют определенному шаблону, который модель изучает, что помогает ей определять положение каждого слова или расстояние между разными словами в последовательности.Интуиция здесь заключается в том, что добавление этих значений к вложениям обеспечивает значимые расстояния между векторами встраивания, когда они проецируются в векторы Q / K / V и во время внимания скалярного произведения.

Чтобы дать модели ощущение порядка слов, мы добавляем векторы позиционного кодирования, значения которых следуют определенному шаблону.

Если мы предположим, что вложение имеет размерность 4, фактическое позиционное кодирование будет выглядеть так:

Реальный пример позиционного кодирования с размером вложения игрушки 4

Как мог бы выглядеть этот узор?

На следующем рисунке каждая строка соответствует позиционному кодированию вектора.Таким образом, первая строка будет вектором, который мы добавим к встраиванию первого слова во входной последовательности. Каждая строка содержит 512 значений - каждое от 1 до -1. Мы присвоили им цветовую кодировку, чтобы узор был виден.

Реальный пример позиционного кодирования для 20 слов (строк) с размером встраивания 512 (столбцов). Вы можете видеть, что он разделен пополам по центру. Это потому, что значения левой половины генерируются одной функцией (которая использует синус), а правая половина генерируется другой функцией (которая использует косинус).Затем они объединяются, чтобы сформировать каждый из векторов позиционного кодирования.

Формула позиционного кодирования описана в статье (раздел 3.5). Вы можете увидеть код для генерации позиционных кодировок в get_timing_signal_1d () . Это не единственный возможный метод позиционного кодирования. Однако это дает преимущество возможности масштабирования до невидимой длины последовательностей (например, если нашу обученную модель просят перевести предложение длиннее, чем любое из предложений в нашем обучающем наборе).

Обновление за июль 2020 года: Позиционное кодирование, показанное выше, взято из реализации преобразователя Tranformer2Transformer. Метод, показанный в статье, немного отличается тем, что он не соединяет напрямую, а переплетает два сигнала. На следующем рисунке показано, как это выглядит. Вот код для его создания:

Остатки

Одна деталь в архитектуре кодера, которую мы должны упомянуть, прежде чем двигаться дальше, заключается в том, что каждый подуровень (самовнимание, ffnn) в каждом кодере имеет остаточное соединение вокруг себя, за которым следует этап нормализации уровня. .

.

Если мы визуализируем векторы и операцию уровня-нормы, связанную с самовниманием, это будет выглядеть так:

Это также относится к подуровням декодера. Если мы представим себе преобразователь из двух стековых кодировщиков и декодеров, он будет выглядеть примерно так:

Сторона декодера

Теперь, когда мы рассмотрели большинство концепций кодировщика, мы в основном знаем, как работают компоненты декодеров.Но давайте посмотрим, как они работают вместе.

Кодер запускает обработку входной последовательности. Затем выходной сигнал верхнего кодера преобразуется в набор векторов внимания K и V. Они должны использоваться каждым декодером на его уровне «внимание кодер-декодер», который помогает декодеру сосредоточиться на соответствующих местах во входной последовательности:

После завершения этапа кодирования мы начинаем этап декодирования. Каждый шаг в фазе декодирования выводит элемент из выходной последовательности (в данном случае предложение английского перевода).

Следующие шаги повторяют процесс до тех пор, пока не будет достигнут специальный символ, указывающий, что декодер трансформатора завершил свой вывод. Выходной сигнал каждого шага подается в нижний декодер на следующем временном шаге, и декодеры выводят свои результаты декодирования так же, как это сделали кодеры. И так же, как мы поступили с входами кодировщика, мы встраиваем и добавляем позиционное кодирование к этим входам декодера, чтобы указать положение каждого слова.

Слои самовнимания в декодере работают немного иначе, чем в кодировщике:

В декодере слой самовнимания может обращать внимание только на более ранние позиции в выходной последовательности.Это делается путем маскирования будущих позиций (устанавливая их на -inf ) перед шагом softmax в расчете самовнимания.

Слой «Внимание кодировщика-декодера» работает так же, как многоголовое самовнимание, за исключением того, что он создает свою матрицу запросов из нижележащего уровня и берет матрицу ключей и значений из выходных данных стека кодировщика.

Последний слой Linear и Softmax

Стек декодера выводит вектор чисел с плавающей запятой. Как превратить это в слово? Это работа последнего слоя Linear, за которым следует слой Softmax.

Линейный слой - это простая полносвязная нейронная сеть, которая проецирует вектор, созданный стеком декодеров, в гораздо более крупный вектор, называемый вектором логитов.

Предположим, что наша модель знает 10 000 уникальных английских слов («выходной словарь» нашей модели), которые она выучила из набора обучающих данных. Это сделало бы вектор логитов шириной 10 000 ячеек - каждая ячейка соответствует количеству уникального слова. Вот как мы интерпретируем вывод модели, за которой следует линейный слой.

Затем слой softmax превращает эти оценки в вероятности (все положительные, все в сумме дают 1,0). Выбирается ячейка с наибольшей вероятностью, и слово, связанное с ней, создается в качестве выходных данных для этого временного шага.

Этот рисунок начинается снизу с вектора, полученного на выходе стека декодера.

Затем оно превращается в выходное слово.

Затем оно превращается в выходное слово.Итоги обучения

Теперь, когда мы рассмотрели весь процесс прямого прохода через обученный преобразователь, было бы полезно взглянуть на интуицию обучения модели.

Во время обучения неподготовленная модель должна пройти точно такой же прямой проход. Но поскольку мы обучаем его на помеченном наборе обучающих данных, мы можем сравнить его выходные данные с фактическими правильными выходными данными.

Чтобы наглядно это представить, предположим, что наш выходной словарь содержит только шесть слов («а», «я», «я», «спасибо», «ученик» и «

Выходной словарь нашей модели создается на этапе предварительной обработки еще до того, как мы начинаем обучение.

Как только мы определим наш выходной словарь, мы можем использовать вектор той же ширины для обозначения каждого слова в нашем словаре. Это также называется горячим кодированием. Так, например, мы можем обозначить слово «am» с помощью следующего вектора:

Пример: быстрое кодирование нашего выходного словаря

После этого резюме давайте обсудим функцию потерь модели - метрику, которую мы оптимизируем на этапе обучения, чтобы создать обученную и, надеюсь, удивительно точную модель.

Функция потерь

Допустим, мы обучаем нашу модель. Допустим, это наш первый шаг на этапе обучения, и мы обучаем его на простом примере - переводе слова «мерси» в «спасибо».

Это означает, что мы хотим, чтобы на выходе было распределение вероятностей с указанием слова «спасибо». Но поскольку эта модель еще не обучена, это вряд ли произойдет.

Поскольку все параметры модели (веса) инициализируются случайным образом, (необученная) модель создает распределение вероятностей с произвольными значениями для каждой ячейки / слова.Мы можем сравнить его с фактическим результатом, а затем настроить все веса модели с помощью обратного распространения ошибки, чтобы приблизить результат к желаемому результату.

Как сравнить два распределения вероятностей? Мы просто вычитаем одно из другого. Для получения дополнительных сведений см. Кросс-энтропию и расхождение Кульбака – Лейблера.

Но учтите, что это упрощенный пример. Более реалистично, мы будем использовать предложение длиннее одного слова. Например - ввод: «je suis étudiant» и ожидаемый результат: «я студент».На самом деле это означает, что мы хотим, чтобы наша модель последовательно выводила распределения вероятностей, где:

Например - ввод: «je suis étudiant» и ожидаемый результат: «я студент».На самом деле это означает, что мы хотим, чтобы наша модель последовательно выводила распределения вероятностей, где:

- Каждое распределение вероятностей представлено вектором ширины vocab_size (6 в нашем игрушечном примере, но более реалистично число вроде 30 000 или 50 000)

- Первое распределение вероятностей имеет самую высокую вероятность в ячейке, связанной со словом «i».

- Второе распределение вероятностей имеет самую высокую вероятность в ячейке, связанной со словом «am».

- И так далее, пока пятое выходное распределение не укажет символ «

<конец предложения>», с которым также связана ячейка из словаря 10000 элементов.

Целевые распределения вероятностей, с которыми мы будем обучать нашу модель в обучающем примере для одного предложения-образца.

После обучения модели в течение достаточного времени на достаточно большом наборе данных мы надеемся, что полученные распределения вероятностей будут выглядеть так:

Надеемся, что после обучения модель выдаст правильный перевод, который мы ожидаем. Конечно, это не настоящее указание на то, была ли эта фраза частью обучающего набора данных (см .: перекрестная проверка).Обратите внимание, что каждая позиция имеет небольшую вероятность, даже если она вряд ли будет результатом этого временного шага - это очень полезное свойство softmax, которое помогает процессу обучения.

Теперь, поскольку модель производит выходные данные по одному, мы можем предположить, что модель выбирает слово с наибольшей вероятностью из этого распределения вероятностей и отбрасывает остальные. Это один из способов сделать это (называется жадным декодированием). Другой способ сделать это - удержаться, скажем, за два верхних слова (например, «I» и «a»), а затем на следующем шаге запустить модель дважды: однажды предполагая, что первая выходная позиция была слово «I», и в другой раз, предполагая, что первой выходной позицией было слово «a», и какая бы версия ни вызвала меньше ошибок, учитывая обе позиции №1 и №2, сохраняется.Мы повторяем это для позиций №2 и №3… и т. Д. Этот метод называется «поиск луча», где в нашем примере beam_size было два (это означает, что всегда две частичные гипотезы (незавершенные переводы) сохраняются в памяти), а top_beams также равно двум (что означает, что мы вернем два перевода. ). Это оба гиперпараметра, с которыми вы можете поэкспериментировать.

Двигайтесь вперед и трансформируйте

Я надеюсь, что вы нашли это полезным местом, чтобы начать ломать голову над основными концепциями Трансформера.Если вы хотите углубиться, я бы посоветовал следующие шаги:

Доработки:

Благодарности

Благодарим Илью Полосухина, Якоба Ушкорейта, Ллиона Джонса, Лукаша Кайзера, Ники Пармар и Ноама Шазира за отзывы о более ранних версиях этого поста.

Пожалуйста, напишите мне в Твиттер, чтобы я мог исправить или оставить отзыв.

Варианты входных трансформаторов для микрофонав 2020 году

Hello ToneAlive,В одном из моих 8000 у меня были только выходные преобразователи.. на 2 стерео выхода шины.

Они были вариантом в то время, как я полагаю, они оседлали Lundahl xformers.

Я чувствовал, что это был шаг вперед по сравнению с теми, у кого не было xformers.

У меня никогда не было xformers на входах (я не помню, могли ли вы их добавить, и с этим я имею в виду, если они уже запланировали входное пространство xfrmr на печатной плате ... У меня нет полосы канала здесь со мной ... и я не помню ... но, может быть, это так ... раз уж вы это делаете, я так думаю ...).

В любом случае .. это сказано..

Несмотря на то, что 8000 - невероятно звучащий стол для своих затрат, он все еще в основном представляет собой стол на базе микросхем ... его можно модифицировать и, я думаю, улучшать во многих областях, хотя я всегда использовал его в стандартной комплектации (с xformr на главном устройстве) и был им доволен. У него есть звук, я бы сказал, что он звучит «естественно», но все же с хорошей энергией. Ему также нравилось, когда его толкали.

Я не уверен, что входной преобразователь существенно изменит или улучшит ситуацию ... это, вероятно, будет иметь значение, но у вас все еще есть предусилитель на базе микросхемы после входного преобразователя..

, поэтому я считаю, что он может быть бесполезным с точки зрения вложений времени / денег ... хотя, если вы думаете изменить и другие части стола, вы наверняка получите лучший стол. ... но это, вероятно, потребует значительных затрат времени и денег. (но на самом деле это будет дешевле, чем получить api).

Мне нравится оперативность и рабочий процесс 8000, он настолько прост, хорошо продуман и содержит множество функций, что иногда я не понимаю других производителей консолей..

это продуманная конструкция с 8 шинами, вдобавок ко всему у вас есть 8 FX возвратов с простым 3-полосным эквалайзером, который отлично позаботится об эквалайзере на возвратах, плюс, если вы хотите, вы можете использовать этот эквалайзер на 8 выходные автобусы ..

Это стол, который говорит со мной, я думаю, все разные .. но мне это понравилось.

По моему опыту, вы не можете классифицировать трансформаторы подобным образом.

Под этим я подразумеваю, что, хотя у каждого xformer есть некоторые характеристики и некоторые «общие» характеристики, на самом деле у них нет «звука».. звук в основном определяется тем, как схема вокруг него спроектирована (и, конечно, как этот трансформатор реагирует).

Вот почему в некоторых конструкциях некоторые преобразователи очень тонкие и чистые, а в других они насыщают и придают отчетливую окраску.

В некоторых отношениях это похоже на лампы ... все говорят о теплоте и искажении ламп, и в некоторых проектах это очень верно, в некоторых других они чисты, как свисток .. это зависит от дизайна и реализации и от того, как цепь заставила среагировать лампу или трансформатор.

Надеюсь, вам понравится 8000, у меня все еще есть мой (на самом деле у меня есть 3, один на запчасти) на продажу, если кому-то это интересно.

Чеу

Массивы- Спецификация пути входного трансформатора JSON

Я пытаюсь преобразовать следующий журнал JSON: (AWS CloudWatch / Trail, если это важно)

{

«eventVersion»: «1.08»,

"userIdentity": {

"type": "IAMUser",

"primaryId": "xxx",

"arn": "arn: aws: iam :: xxx",

"accountId": "xxx",

"accessKeyId": "xxx",

"userName": "xxx",

"sessionContext": {

"sessionIssuer": {},

"webIdFederationData": {},

"attributes": {

"mfaAuthenticated": "правда",

"creationDate": "2021-01-07T13: 50: 07Z"

}

}

},

"eventTime": "2021-01-07T14: 55: 03Z",

"eventSource": "ec2.amazonaws.com ",

"eventName": "AuthorizeSecurityGroupIngress",

"awsRegion": "us-east-1",

"sourceIPAddress": "xxx",

"userAgent": "console.ec2.amazonaws.com",

"requestParameters": {

"groupId": "sg-xxx",

"ipPermissions": {

"Предметы": [

{

«ipProtocol»: «tcp»,

«fromPort»: 22,

«toPort»: 22,

"группы": {},

"ipRanges": {

"Предметы": [

{

"cidrIp": "x.x.x.x / 32 "

"описание": "х"

}

]

},

"ipv6Ranges": {},

"prefixListIds": {}

}

]

}

},

"responseElements": {

"requestId": "xxx",

"_return": правда

},

"requestID": "xxx",

"eventID": "xxx",

"readOnly": ложь,

"eventType": "AwsApiCall",

"managementEvent": правда,

"eventCategory": "Менеджмент",

"recipientAccountId": "xxx"

}

К следующему выводу:

"AuthorizeSecurityGroupIngress сделано против sg-xxx на [имя учетной записи] от [user @ x.x.x.x] "

"Диапазон портов: 22"

"Исходный IP: x.x.x.x"

"Описание: x"

В настоящее время, передав эти 2 блока во входной трансформатор CloudWatch:

{

"event": "$. detail.eventName",

"sg": "$. detail.requestParameters.groupId",

"user": "$. detail.userIdentity.userName",

"sourceip": "$. detail.sourceIPAddress",

"dsc": "$. detail.requestParameters.ipPermissions.items"

}

"<событие>, совершенное против на [имя учетной записи] от [ @ ]"

"Подробности: "

Я могу создать следующий вывод:

"AuthorizeSecurityGroupIngress сделано против sg-xxx на [имя учетной записи] от [x @ x.x.x.x] "

"Подробности: {items: [{ipProtocol: tcp, fromPort: 22, toPort: 22, groups: {}, ipRanges: {items: [{cidrIp: xxxx / 32, description: x}]}, ipv6Ranges: {} , prefixListIds: {}}]} «

Однако, когда я пытаюсь указать путь ввода еще дальше, передавая более конкретные заполнители:

{

"event": "$. detail.eventName",

"sg": "$. detail.requestParameters.groupId",

"user": "$. detail.userIdentity.userName",

"sourceip": "$. detail.sourceIPAddress",

"prt": "$.detail.requestParameters.ipPermissions.items.toPort ",

"src": "$. detail.requestParameters.ipPermissions.items.ipRanges.items.cidrIp",

"dsc": "$. detail.requestParameters.ipPermissions.items.ipRanges.items.description"

}

"<событие>, совершенное против на [имя учетной записи] от [ @ ]"

"Диапазон портов: "

"Исходный IP: "

"Описание: "

Выходные данные пустые для значений заполнителей (prt, src, dsc):

"AuthorizeSecurityGroupIngress сделано против sg-xxx на [имя учетной записи] от [user @ x.x.x.x] "

"Диапазон портов:"

"Исходный IP:"

"Описание:"

VS. ожидается

«AuthorizeSecurityGroupIngress для sg-xxx на [имя учетной записи] от [[email protected]]»

"Диапазон портов: 22"

"Исходный IP: x.x.x.x"

"Описание: x"

Где я испортил путь ввода?

Причина проблемы заключается в скобках «[]»?

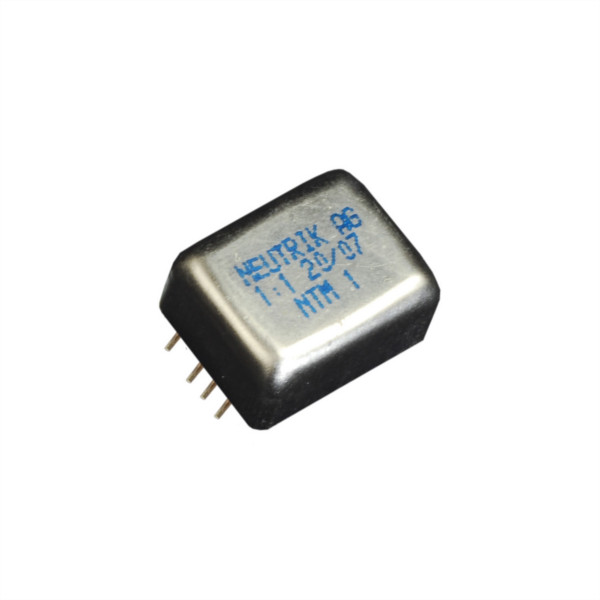

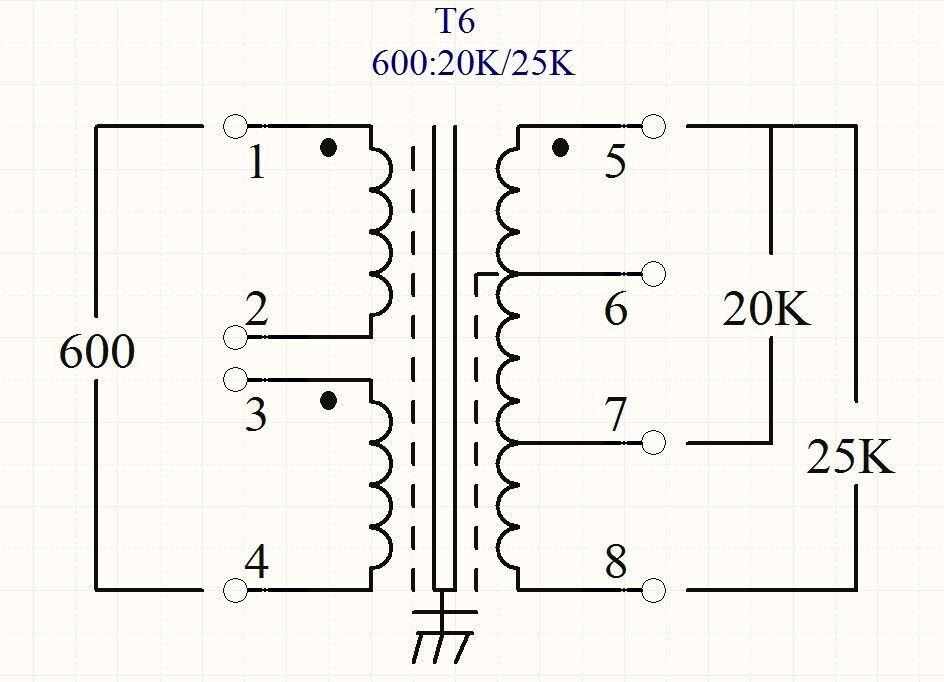

OEP Z21808C TRANSFORMER Аналоговый звук, печатная плата, микрофонный вход

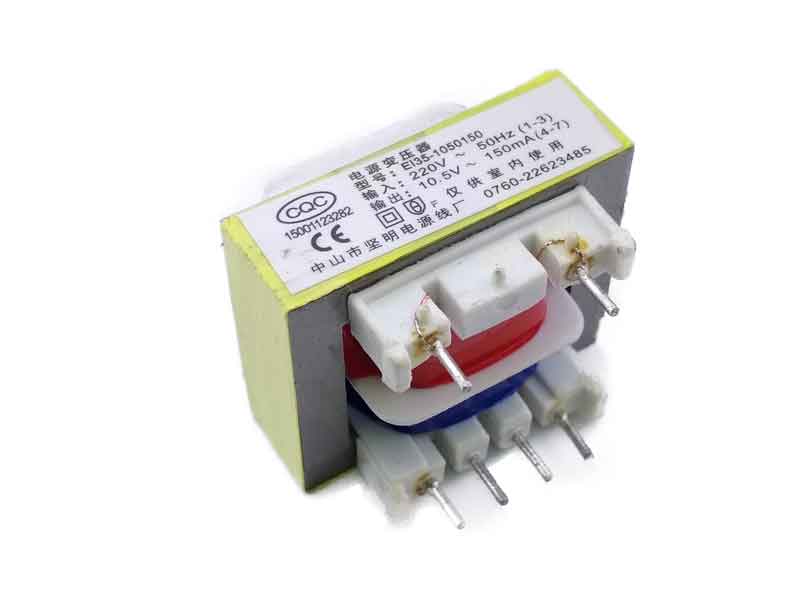

Линейка недорогих трансформаторов для монтажа на печатную плату, производимых OEP в Англии.Типы A262 и Z3003E поставляются без грохотов, они доступны как дополнительная опция. В сериях Z218 установлены экранирующие банки из мю-металла, в то время как Z1604 и E187A не имеют экранирования. Полные данные и примечания по применению для каждого типа доступны на веб-сайте OEP www.oep.co.uk или в службе технической поддержки Canford.

Z21805C

Подходит для микрофонных входных каскадов, оптимизированных для низкого сопротивления источника (500–1000 Ом), типичного для биполярных транзисторов с низким сопротивлением Rbb и операционных усилителей, таких как LT1208.Его также можно использовать для входов линейного уровня при использовании в активных входных цепях текущего режима. Передаточное отношение 1: 2 на выходе 0,5. Размеры: 19,5 (длина) x 16,0 (ширина) x 14,95 (высота над печатной платой) мм.

Z21806C

Подходит для входных каскадов линейного уровня, использующих текущий режим или технику «нулевого поля». Это устраняет большинство артефактов, обычно связанных с аудиопреобразователями, сохраняя при этом желаемую гальваническую развязку, блокирующую радиопомехи. Передаточное отношение 1: 1. Размеры: 19,5 (л) x 16.0 (ширина) x 14,95 (высота над печатной платой) мм.

Z21807C

Подходит для входных каскадов линейного уровня (мостовое соединение 10–20 кОм). Передаточное число витков 1: 0,5 + 0,5. Размеры: 19,5 (длина) x 16,0 (ширина) x 14,95 (высота над печатной платой) мм.

Z21808C

Подходит для микрофонных входных каскадов, оптимизированных для средних сопротивлений источника (около 5 кОм), типичных для биполярных транзисторов со средним сопротивлением Rbb и операционных усилителей, таких как NE5534.